OpenAI travaille sur un moyen d’ajouter un « filigrane » aux informations générées par l’intelligence artificielle. L’idée est de développer un outil permettant de « filtrer statistiquement » les résultats de ses systèmes d’IA qui génèrent du texte.

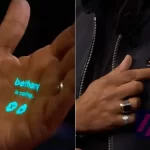

Chaque fois qu’un système comme ChatGPT génère du texte, l’outil comprendrait un signal secret « imperceptible » indiquant la provenance du texte.

Pourquoi un filigrane est-il nécessaire pour le contenu généré par l’IA ?

ChatGPT est un exemple de la manière dont l’IA peut générer des textes de grande qualité, mais il soulève également des problèmes éthiques. Comme de nombreux autres systèmes de génération de texte avant lui, ChatGPT pouvait être utilisé pour rédiger des courriels d’hameçonnage de haute qualité, des logiciels malveillants nuisibles ou pour tricher dans des travaux scolaires ou universitaires. L’objectif de l’outil de filigrane d’OpenAI est de rendre plus difficile l’utilisation du résultat d’un système d’IA comme s’il avait été écrit par un humain. Cela pourrait être utile pour prévenir le plagiat académique, la production massive de propagande et l’incrimination d’une personne en imitant son style d’écriture.

Que se passera-t-il si l’internet est rempli de contenu généré par des centaines ou des milliers d’IA ?

Et bien sûr, le principal problème est le retour d’information des IA elles-mêmes. Une IA comme ChatGPT se nourrit de tonnes de données que des milliers de personnes ont générées. Mais que se passera-t-il si l’internet est rempli de contenu généré par des centaines ou des milliers d’IA ? Ce serait un gros problème si ces mêmes IA commençaient à utiliser le contenu auto-généré pour générer plus de contenu. Nous avons donc un problème, messieurs. Voyons comment ce domaine se développe pour éviter l’effondrement.

Comment fonctionne l’outil de filtrage d’OpenAI ?

L’outil fonctionne comme une « enveloppe » au-dessus des systèmes de génération de texte existants, utilisant une fonction cryptographique au niveau du serveur pour « sélectionner aléatoirement » le jeton token. Le texte généré semblerait toujours aléatoire, mais toute personne possédant la « clé » de la fonction cryptographique serait en mesure de découvrir le filigrane. Les ingénieurs d’OpenAI ont déjà construit un prototype fonctionnel de l’outil, et l’espoir est de l’intégrer dans les futurs systèmes développés par OpenAI.