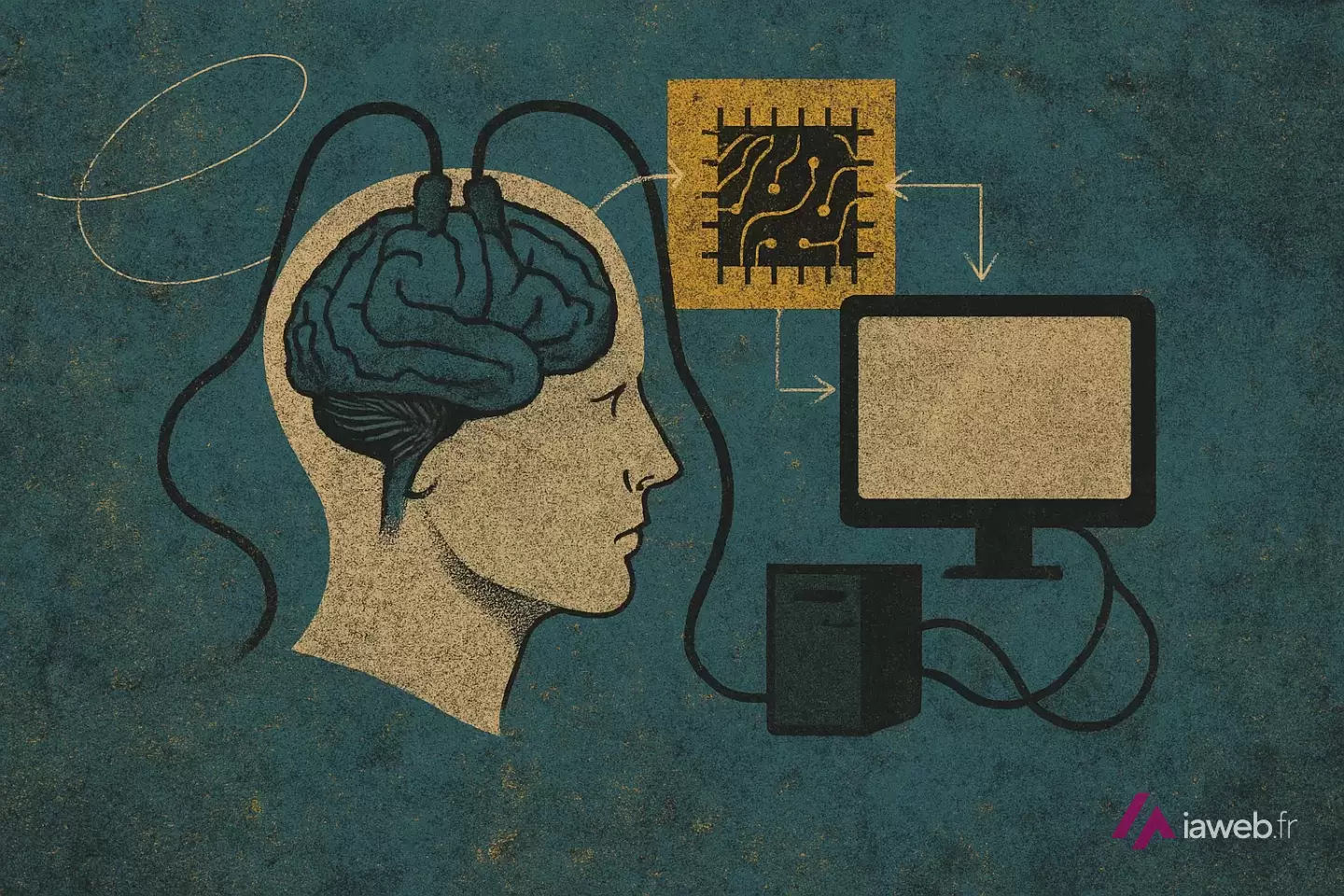

Dans une avancée passionnante dans le domaine de l’interface cerveau-ordinateur (BCI), des scientifiques de l’UC Berkeley et de l’UC San Francisco ont réalisé de grands progrès en permettant aux personnes atteintes de paralysie sévère de communiquer grâce à un système qui convertit les signaux cérébraux en parole presque en temps réel. Ce développement aborde l’un des plus grands défis de la neuroprothèse de la parole : le temps de réponse entre la pensée et l’expression verbale.

La technologie, qui a été publiée dans Nature Neuroscience, utilise intelligence artificielle pour décoder les signaux du cerveau et produire des mots de manière presque instantanée, offrant une fluidité dans l’expression qui permet aux utilisateurs de communiquer de manière continue, sans pauses significatives. Cette étude a été financée par l’Institut national sur la surdité et autres troubles de la communication (NIDCD) des Instituts nationaux de la santé (NIH).

Un système qui transforme les pensées en mots

“Notre système de transmission utilise des algorithmes similaires à ceux employés par des dispositifs comme Alexa ou Siri pour décoder les signaux cérébraux et produire de la parole presque aussi vite que l’on pense”, a commenté Gopala Anumanchipalli, co-chercheur principal et professeur assistant à l’UC Berkeley. C’est le premier système qui a réussi à synthétiser des discours fluides et continus directement à partir de données neuronales.

Ce système innovant est polyvalent et fonctionne avec différents dispositifs, utilisant des méthodes non invasives qui mesurent l’activité musculaire faciale à travers des capteurs sur la peau, ainsi que des systèmes plus complexes impliquant des électrodes placées directement dans le cerveau. Kaylo Littlejohn, doctorant et co-auteur de l’étude, a mentionné que l’algorithme peut s’adapter à diverses configurations de surveillance cérébrale, tant qu’il a accès à des signaux fiables.

La neuroprothèse convertit l’activité neuronale du cortex moteur cérébral, qui contrôle la parole, en mots, une fois que la personne a formé la pensée et est prête à mouvoir les muscles vocaux. Pour entraîner le système, un participant a tenté de parler en silence pendant que les chercheurs enregistraient son activité cérébrale. Les modèles d’IA ont complété les détails manquants, comme les motifs sonores, pour générer le discours.

Un aspect remarquable de cette avancée est que l’équipe a utilisé la voix du participant avant sa blessure comme référence, garantissant que le résultat sonnait familier et personnel. Auparavant, les études montraient un délai de 8 secondes dans le décodage de phrases complètes, mais la nouvelle méthode parvient à produire une parole audible en moins d’une seconde. Cette réponse plus rapide s’accompagne d’une grande précision, démontrant que la transmission en temps réel est possible sans sacrifier la qualité.

Pour évaluer la flexibilité, les chercheurs ont synthétisé des mots rares qui ne faisaient pas partie de l’ensemble d’entraînement du système, comme ceux de l’alphabet phonétique de l’OTAN (“Alpha”, “Bravo”, etc.). La technologie a fonctionné de manière efficace, indiquant son potentiel pour un usage plus large du vocabulaire.

Edward Chang, chercheur senior et neurochirurgien à l’UCSF, a souligné les applications dans le monde réel. “Cette innovation nous rapproche d’interfaces cerveau-ordinateur pratiques qui peuvent améliorer considérablement la communication pour ceux qui ont des handicaps sévères de la parole”, a-t-il affirmé.

Dans de futures recherches, l’objectif sera d’améliorer le ton émotionnel et l’expressivité de la parole, afin de refléter les changements de ton, de volume et d’émotion, rendant la sortie plus réaliste. Avec davantage de perfectionnements, cette technologie pourrait transformer les options de communication pour les personnes qui ne peuvent pas parler.